Muchos vaticinaban que 2024 sería el año en que todo el mundo votaría bajo el influjo de imágenes sintéticas creadas por maquinarias de propaganda propulsadas por inteligencia artificial. Efectivamente, la IA generativa fue usada maliciosamente en las campañas electorales de 2024 y también en las campañas de 2025. No obstante, estas aplicaciones parecen tener efectos mínimos o marginales en los resultados electorales. La evidencia indica que los clivajes políticos y las narrativas de largo alcance, tejidas a lo largo de generaciones de historia y cultura, tienen un impacto más significativo en el voto que los videos generados por IA. ¿Quién lo habría imaginado? La realidad, una vez más, se mostró más compleja y más sujeta a la agencia humana de lo que los titulares sensacionalistas predecían.

Ansiedades y espejismos

El discurso público sobre la inteligencia artificial a menudo se ve teñido por un fenómeno bien conocido en el mundo de la comunicación: el sesgo negativo de los medios. Estrategias probadas para captar la atención de las audiencias llevan a los medios a priorizar coberturas que generan alarma, controversia o miedo, ya que estas suelen captar más la atención de las audiencias.

En el caso de IA, este sesgo, conlleva a que, en lugar de ofrecer un análisis matizado, los medios se enfocan en escenarios hipotéticos que rozan la ciencia ficción como la pérdida total de control sobre las máquinas o riesgos existenciales que amenazan la supervivencia misma de nuestra especie. Las audiencias son seducidas por el espejismo de androides con conciencia propia, capaces de sustituir a los humanos en cada faceta de la vida, o simplemente, dominarnos. Así, se ha propagado con una velocidad asombrosa la narrativa del riesgo existencial de una hipotética inteligencia artificial general o superinteligencia, una entidad con capacidades cognitivas muy superiores a las humanas. Relatos construidos sobre las ansiedades en torno al futuro.

Esto relatos, en gran medida, carecen de base empírica sólida. Y lo que es más preocupante, funcionan como una distracción. Mientras nos obsesionamos con futuros distópicos, desviamos nuestra atención de problemas apremiantes y muy reales asociados al desarrollo tecnológico actual. Centrarse en escenarios apocalípticos desvía el foco de debates cruciales sobre las promesas y los riesgos tangibles de los sistemas de IA que ya estamos en condiciones de implementar, y que ya están impactando nuestras vidas.

Las sombras de la IA: Vigilancia y control

Mientras la imaginación colectiva se pierde en salones de escape habitados por robots asesinos y conciencias digitales, temas de alto impacto como el uso de aplicaciones de inteligencia artificial para el control de la población y la represión en contextos autoritarios no generan batallas de opiniones en redes sociales, ni alimentan coberturas mediáticas. Los opinadores, generalmente, ignoran los usos actuales de la IA en la fusión de bases de datos masivas y el reconocimiento de patrones de comportamiento de individuos y comunidades sometidas a vigilancia continua.

Pensemos, por un momento, en la capacidad de cruzar datos de cámaras de seguridad, registros telefónicos, transacciones financieras y actividad en redes sociales. La IA no solo puede identificar rostros o voces; puede predecir comportamientos, señalar disidentes, y construir perfiles detallados de ciudadanos. Esta digitalización de los aparatos represivos no es una amenaza futura, sino una realidad palpable en muchos países autocráticos alrededor del mundo, incluyendo, lamentablemente, algún país latinoamericano cercano a nuestras emociones personales. Apenas unos pocos especialistas, que exploran la intersección entre tecnologías y democracia, nos interesamos en analizar las implicaciones de estas herramientas en contextos represivos. La verdadera distopía no es la rebelión de las máquinas, sino su uso como ojos omnipresentes de regímenes que buscan suprimir la libertad.

Desmitificando la máquina

Los avances actuales en el aprendizaje automático y los modelos grandes de lenguaje (LLM), como los que nos permiten interactuar con chatbots o generar textos, pueden resultar impresionantes, pero no marcan un camino directo hacia la inteligencia general autónoma tal como la han imaginado los relatos literarios y cinematográficos sobre robots desde los 1920s. Los LLM, con su capacidad para generar texto coherente y realizar tareas estructuradas, operan como sistemas de reconocimiento y predicción de patrones. Su mayor destreza es predecir con mucha precisión que palabra o que token sigue a otro.

Sin embargo, estos modelos carecen de capacidades fundamentales de la inteligencia humana: una comprensión genuina del mundo, un razonamiento causal robusto (es decir, entender por qué las cosas suceden), intencionalidad o sentido común. Un LLM puede generar un texto sobre la moralidad, pero no tiene un sistema de valores intrínseco. La frontera de la IA enfrenta retos teóricos y técnicos enormes para lograr un aprendizaje continuo y adaptativo, resolver problemas de significado o semántica y alcanzar una capacidad de generalización flexible similar a la humana. No estamos ante la creación de una “mente” consciente, sino ante herramientas para procesar y generar información con mucha velocidad.

Para una comprensión más equilibrada y crítica de la IA, es fundamental resistir la simplificación excesiva. Solo así podremos abordar los desafíos que realmente requieren regulación, al tiempo que aprovechamos las oportunidades para el progreso humano en campos tan vitales como la medicina (comenzando con los ensayos clínicos de nuevos fármacos), la planificación urbana (optimizando las zonificaciones de uso) o el transporte (controlando sistemas de movilidad masiva más seguros y eficientes).

La promesa de lo pequeño: Modelos de lenguaje de dominio específico

En medio de la fascinación por los LLM de propósito general, hay también un espacio promisor en el desarrollo de modelos de lenguaje pequeños (SLM) de dominio específico. Estos modelos se entrenan con conjuntos de datos más reducidos y se diseñan para aplicarse a tareas y contextos muy específicos. Imaginen un SLM entrenado exclusivamente para analizar riesgos en las comunicaciones de una organización o para gestionar cursos adaptativos en temas muy especializados.

La optimización de SLM puede permitir una relación costo-efectividad significativamente mejor, ya que requieren menos recursos computacionales para su entrenamiento y funcionamiento. Esto se traduce en un menor consumo energético, lo que es crítico en países que tienen una capacidad de generación de energía que ya es deficitaria. Además, la escalabilidad de los SLM podría abrir oportunidades de implementación en dispositivos con recursos limitados, como teléfonos móviles en zonas rurales con conectividad intermitente. Esto democratizaría el acceso a la IA, llevándola a manos de comunidades que hoy quedan al margen de la transformación digital.

No obstante, el desarrollo de SLM para dominios específicos exige una evaluación realista de los desafíos inherentes y un esfuerzo considerable para aprovechar su potencial. Garantizar la robustez y mitigar el sesgo en modelos entrenados con conjuntos de datos más restringidos requiere una curación de datos de mayor calidad y la implementación de procesos de optimización rigurosos. Un conjunto de datos pequeño puede fácilmente amplificar sesgos existentes. Asimismo, el alcance de una sofisticación comparable a la de los LLM en la ejecución de tareas complejas dentro de dominios especializados para los SLM, demanda una investigación sostenida y un desarrollo iterativo. No es una solución simple de implementar, pero sí una ruta hacia una IA más distribuida.

La IA al servicio del interés público

Otro ruta positiva es el desarrollo de la inteligencia artificial de interés público. Esta se define como el desarrollo y la implementación de IA centrada en resultados sociales, económicos y ambientales beneficiosos para el interés público global. Para lograr expandir a nivel mundial el enfoque de inteligencia artificial de interés público, es crucial considerar la realidad de las comunidades a las que se intenta servir, particularmente los desafíos que enfrentan los países en desarrollo. Un tema que despierta un entusiasmo considerable es aprovechar la IA para acelerar el logro de los Objetivos de Desarrollo Sostenible (ODS) de las Naciones Unidas. Consideremos la viabilidad de aplicaciones de IA para rastrear el ciclo de vida de los productos, facilitando el reciclaje y la reutilización, o para identificar fugas en las redes de suministro de agua o para analizar datos públicos e identificar indicios de corrupción o ineficiencias. El potencial es inmenso.

La verdadera amenaza

En los debates sobre el desarrollo de inteligencia artificial con expertos del Caribe, América Latina y África, tres ideas surgen constantemente, como un eco de una preocupación profunda y compartida.

- El desarrollo de un ecosistema para la innovación impulsada por la IA: Esto implica mucho más que simplemente enseñar a programar. Requiere una educación integral en tecnología, acceso a infraestructura digital de calidad (e.g. internet de alta velocidad), y, crucialmente, financiamiento suficiente para la investigación y el desarrollo local. Pero no sólo eso, también se necesitan condiciones laborales justas que permitan mantener el talento en los países en desarrollo, evitando la “fuga de cerebros” hacia naciones más ricas. Sin oportunidades atractivas y un entorno seguro en casa, el talento emigrará, y con él, la capacidad de innovar y aplicar la IA a los problemas locales.

- Mapear los recursos disponibles e incentivar la infraestructura compartida: El desarrollo de la IA es intensivo en recursos. Demanda electricidad para alimentar los centros de datos y grandes volúmenes de agua para enfriarlos. En regiones donde estos recursos son escasos o su acceso es desigual, la expansión de la IA puede exacerbar problemas existentes. Por ello, es vital mapear los recursos disponibles e incentivar la infraestructura compartida para promover la sostenibilidad. Esto podría significar la creación de centros de datos regionales eficientes, impulsados por energías renovables, que sirvan a múltiples países, optimizando el uso de recursos y reduciendo la huella ambiental.

- Garantizar los flujos de capital para las empresas emergentes: La innovación en IA avanza aceleradamente. Para que las empresas emergentes en los países del Caribe, América Latina y África puedan prosperar y competir, necesitan acceso a capital de riesgo y a inversores que comprendan el desafío de la innovación acelerada. Las estructuras de financiación tradicionales, a menudo lentas y reacias al riesgo, no son adecuadas. Se requieren mecanismos que faciliten la inversión ágil y el apoyo a emprendedores locales que desarrollan soluciones de IA adaptadas a sus propias necesidades.

Si no se atienden estos tres factores con la urgencia que merecen, la IA efectivamente tendrá efectos catastróficos en los países que queden fuera de la era de la información digital. Pero, y esto es crucial recalcarlo, no será por la fabricación de imágenes artificiales que engañen a los votantes, las “alucinaciones” de los chatbots que confunden a los usuarios o el surgimiento de una superinteligencia que domine a los humanos. La gran amenaza, la que realmente debería quitarnos el sueño, es simplemente la ampliación de la brecha de conocimiento y bienestar. Una brecha que dejará a millones de personas y naciones rezagadas, sin las herramientas ni las oportunidades para participar en la economía y la sociedad del futuro.

¿Estamos preparándonos para afrontar esta realidad? ¿O seguiremos distraídos por fantasmas tecnológicos mientras la verdadera amenaza nos acecha?

Tomado de https://letraslibres.com/

Más historias

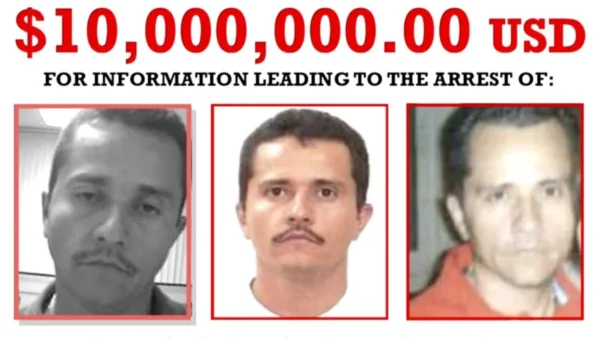

🔴 ¡Caída histórica! Abatido «El Mencho», líder del CJNG, en Jalisco: México entra en alerta máxima

Claudiashein : Programas para el Bienestar. San Pedro, Coahuila https://t.co/m757ZToK4V

ErnestinaGodoy_ : Concluí una jornada laboral productiva, exhaustiva y muy emotiva, durante mi visita al estado de Coahuila. Esta emotividad, se desprende de haber participado en la reunión encabezada por la Presidenta @Claudiashein, con familiares de los 65 trabajadores que hace 20 años, https://t.co/8YruTxqXke