Un mensaje del CEO de Google y Alphabet, Sundar Pichai:

La información es el centro del progreso humano. Por ese motivo, nos enfocamos desde hace 26 años en nuestra misión de organizar la información del mundo y hacerla accesible y útil. También es la razón por la que seguimos extendiendo las fronteras de la IA para organizar esa información a través de cada entrada y ofrecerla a través de cada salida, de modo que sea realmente útil para ti.

Esa era nuestra visión cuando presentamos Gemini 1.0 el diciembre pasado. Como el primer modelo desarrollado para ser multimodal de manera nativa, Gemini 1.0 y 1.5 impulsaron grandes avances en la multimodalidad y el contexto ampliado para comprender información en texto, video, imágenes, audio y código, y procesar mucho más de ese contenido.

Actualmente, millones de desarrolladores usan Gemini. Eso nos ayuda a reimaginar todos nuestros productos (incluidos los siete utilizados por 2 mil millones de usuarios) y a crear otros nuevos. NotebookLM es un gran ejemplo de lo que la multimodalidad y el contexto ampliado pueden hacer por las personas.

Durante el último año, invertimos en el desarrollo de más modelos con capacidades de agentes de IA, que pueden comprender mejor el mundo que te rodea, adelantarse varios pasos y realizar acciones por ti, bajo tu supervisión.

Hoy nos entusiasma lanzar nuestra próxima línea de modelos desarrollados para esta era de agentes de IA: Gemini 2.0 es nuestro modelo más capaz hasta el momento. Con avances en multimodalidad, como resultados de imágenes y audio nativos, y uso de herramientas nativas, nos permitirá desarrollar nuevos agentes de IA que nos acerquen a nuestra visión de un verdadero asistente universal.

Pondremos 2.0 a disposición de desarrolladores y verificadores de confianza hoy mismo. Además, estamos trabajando para implementarlo rápidamente en nuestros productos, empezando por Gemini y el Buscador. A partir de hoy, nuestro modelo Gemini 2.0 Flash Experimental estará disponible para todos los usuarios de Gemini. También lanzamos una nueva función llamada Deep Research, que aplica razonamiento avanzado y funciones de contexto ampliado para actuar como asistente de investigación y explorar temas complejos y compilar informes por ti. Ya está disponible en Gemini Advanced.

Ninguno de nuestros productos fue transformado más por la Inteligencia Artificial que el Buscador. Nuestras Visiones Generales creadas por IA ya llegan a mil millones de usuarios, a quienes les permiten hacer nuevas preguntas. Rápidamente, se transformó en una de las funciones más populares en la historia de la búsqueda. El paso siguiente será llevar las funciones de razonamiento avanzado de Gemini 2.0 a la Visiones Generales creadas por IA para resolver temas más complejos y conjuntos de preguntas, incluidas ecuaciones matemáticas avanzadas, preguntas multimodales y código. Empezamos unas pruebas limitadas esta semana y el lanzamiento más amplio será por etapas el próximo año. Además, seguiremos ofreciendo la Vision General creada por IA a más países e idiomas durante 2025.

Los avances de 2.0 se basan en una década de inversiones en nuestro enfoque diferenciado de full-stack para la innovación en IA. Está integrado en hardware personalizado, como Trillium, nuestras TPUs de sexta generación. Las TPUs impulsaron el 100% del entrenamiento y la inferencia de Gemini 2.0, y actualmente, Trillium está disponible de manera general para que los clientes también puedan usarlo para desarrollar.

Si Gemini 1.0 tenía como fin organizar y comprender información, Gemini 2.0 tendrá como objetivo hacerlo mucho más útil. No puedo esperar a ver qué traerá la próxima era.

-Sundar

Tomado de https://blog.google/

Más historias

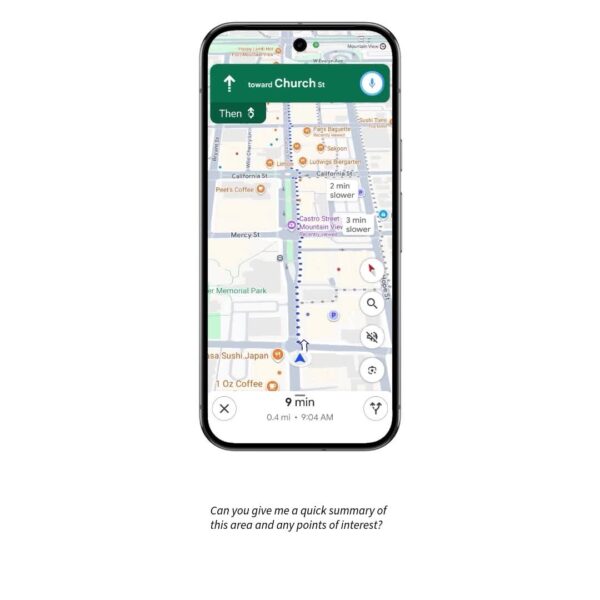

La navegación de Google Maps con Gemini ya está disponible para peatones y ciclistas

Inteligencia Personal en Modo IA en el Buscador: ayuda que es solo tuya

Con el apoyo de Google.org, RIL está transformando la gestión pública con IA en América Latina